CopyRight 2009-2020 © All Rights Reserved.版权所有: 中国海关未经授权禁止复制或建立镜像

基于YOLO-Transformer算法的菌落智能计数方法研究

作者:金晓蕾 刘慧玲 凡思琦 牛娜 吴宛珊 丁晶 涂晓波

金晓蕾 刘慧玲 凡思琦 牛娜 吴宛珊 丁晶 涂晓波

金晓蕾 1,2 刘慧玲 1,2 凡思琦 1,2 牛 娜 1,2 吴宛珊 1,2 丁 晶 1,2 涂晓波 1 ,2 *

摘 要 本研究针对微生物检验中菌落人工计数效率问题,对一种基于Transformer结构改进的YOLO菌落智能计数方法进行研究。通过融合Transformer架构与YOLO目标检测算法,开发出具备抗干扰能力的菌落智能分析模型,实现了微生物菌落的智能识别与计数。为验证该方法的有效性,研究选用标准菌株制备不同浓度菌悬液,通过人工污染有代表性样品基质的方式,获取菌落图像数据集,系统对比了基于YOLO-Transformer智能算法的仪器计数法与目测法在准确度、精密度等方面的指标。实验结果表明:2种方法的计数结果的准确度均符合要求,其β-期望容忍区间(β-ETI)上限U和下限L均在±0.5范围内;在重复性测试中,仪器法的相对标准偏差(Relative Standard Deviation,RSD)分别为4.19%、2.28%、3.13%,目测法的RSD为4.64%、4.01%、3.83%;在再现性测试中,仪器法的RSD为0.70%,目测法的RSD为3.68%,均小于10%,符合相关要求。本研究提出的方法能够提升微生物菌落识别与计数检测的效率及准确度,为微生物检验工作提供技术支持。

关键词 菌落智能计数;YOLO-Transformer;机器学习;微生物

Research on an Intelligent Colony Counting Method Based on the YOLO-Transformer Algorithm

JIN Xiao-Lei1,2 LIU Hui-Ling1,2 FAN Si-Qi1,2 NIU Na1,2

WU Wan-Shan1,2 DING Jing1,2 TU Xiao-Bo1,2*

Abstract This paper addresses the low efficiency of manual colony counting in microbial testing by investigating an intelligent colony counting method on a YOLO-based algorithm enhanced with a Transformer architecture. By integrating the Transformer architecture with the YOLO object detection algorithm, an intelligent colony analysis model with anti-interference capabilities was developed, enabling intelligent recognition and counting of microbial colonies. To validate the effectiveness of the proposed method, the research selects standard bacterial strains to prepare bacterial suspensions at different concentrations and artificially contaminates representative sample substrates to obtain a colony image dataset. A systematic comparison was conducted between the instrument-based counting method using the YOLO–Transformer intelligent algorithm and the traditional visual counting method in terms of accuracy, precision, and other indicators. The experimental results show that, the counting accuracy of both methods meets relevant requirements with the upper (U) and lower (L) limits of β-ETI falling within the range of ±0.5. In repeatability tests, the relative standard deviations (RSD) of the instrument method are 4.19%, 2.28%, and 3.13%, while the those of the visual method are 4.64%, 4.01%, and 3.83%. In reproducibility tests, the RSD of the instrument method is 0.70 %, and the RSD of the visual method is 3.68%. All RSD values are below 10%, meeting the requirements. This method can effectively improve the efficiency and accuracy of microbial colony recognition and counting, providing reliable technical support for microbiological testing applications.

Keywords intelligent colony counting; YOLO-Transformer; machine learning; microbiology

基金项目:食品安全国家标准立项计划(spaq-2024-21)

第一作者:金晓蕾(1987—),女,汉族,黑龙江哈尔滨人,本科,工程师,主要从事食品及微生物检验工作,E-mail: jxltina@126.com

通信作者:涂晓波(1988—),男,汉族,广东梅州人,本科,副高级工程师,主要从事食品及微生物检验工作,E-mail: 654964533@qq.com

1. 深圳海关食品检验检疫技术中心 深圳 518000

2. 深圳市检验检疫科学研究院 深圳 518010

1. Food Inspection and Quarantine Technology Center, Shenzhen Customs, Shenzhen 518000

2. Shenzhen Academy of Inspection and Quarantine, Shenzhen 518010

菌落总数是衡量微生物污染水平的核心检测指标,其计数结果的准确性直接影响微生物检验效率与质量,而精准的微生物污染监测是筑牢公共卫生安全防线的关键支撑。当前,行业普遍采用平板培养法作为基准检测方法,该方法因操作便捷、成本可控等特点,在食品工业质量管控中广泛应用。但该方法依赖人工视觉判读,在一定程度上存在持续目视检测易导致视觉疲劳,进而识别出现偏差的问题。

近年来,随着计算机视觉与智能算法的快速发展,基于图像处理技术的自动化菌落计数解决方案逐渐成熟。行业内相继推出多种类型的智能计数设备-,通过特征识别与智能分析技术取代传统人工判读,形成一种新型数字化检测方法。相较于传统方法,该方法不仅显著减轻了检测人员的工作负荷,更有效提升了检测结果的准确性与可重复性。但面对冷凝液滴、标记笔迹或培养基杂质等干扰因素时,现有智能系统仍可能出现计数偏差或遗漏,需专业人员二次复核修正,这在一定程度上影响了检测效率的提升。

本研究将YOLO-Transformer模型引入微生物检测领域,该模型在小目标识别领域展现出显著优势。通过融合计算机视觉与智能分析技术,重点解决传统检测中连续性要求严格、人工记忆误差,以及现有智能系统在复杂基质环境下的识别问题,针对小目标检测和复杂背景干扰等问题进行优化。结果证明,该模型在提高识别准确性的同时,实现菌落自动识别与计数的智能化,提升复杂环境下菌落识别的准确率与检测通量。

1 材料与方法

1.1 材料与试剂

试剂:平板计数营养琼脂(北京陆桥技术有限公司,批号:230520);氯化钠(广州化学试剂厂,批号:20220702)。测试样品来源于深圳海关食品检验检疫技术中心。试验菌株:大肠埃希氏菌(ATCC 25922)、金黄色葡萄球菌(ATCC 6538)、柠檬酸杆菌(ATCC 43162)。

1.2 仪器与设备

微生物培养观测工作站(MCI-50,内置YOLO-Transformer模型,广州合木仟行科技有限公司);生物安全柜(NU 425-400E,美国NUAIR公司);高压灭菌锅(HVA-85,日本HIRAYAMA公司);电子天平(DilutorW,西班牙IUL公司);漩涡振荡器(88880018,美国Thermo公司);均质器(400VW,法国AES Chemunex公司);恒温恒湿培养箱(KB240,德国BINDER公司)。

1.3 方法

1.3.1 YOLO-Transformer模型

Transformer架构由Vaswani等于2017年提出,以其自注意力机制在编码—解码结构中实现高效序列建模,显著突破了传统循环网络的限制。YOLO系列算法基于Redmon等提出的单阶段检测范式,因其高效的实时检测性能而在工业级视觉系统中展现出显著优势。本研究基于 Bochkovskiy的优化实现,构建包含采用CSPDarknet53架构以提升小目标特征保留率的特征提取器、融合改进型 FPN-PAN 双路交互机制以实现快速多尺度特征融合的多级特征聚合模块、采用深度可分离卷积与动态感知预测层-协同架构以压缩参数量并保持实时性的动态检测头的三级联特征解析架构,该架构所基于的YOLO系列算法因单阶段检测范式带来的实时检测性能等优势,被广泛应用于智能安保-、智能驾驶-、工业检测、细胞识别与检测-、医疗影像分析等领域。

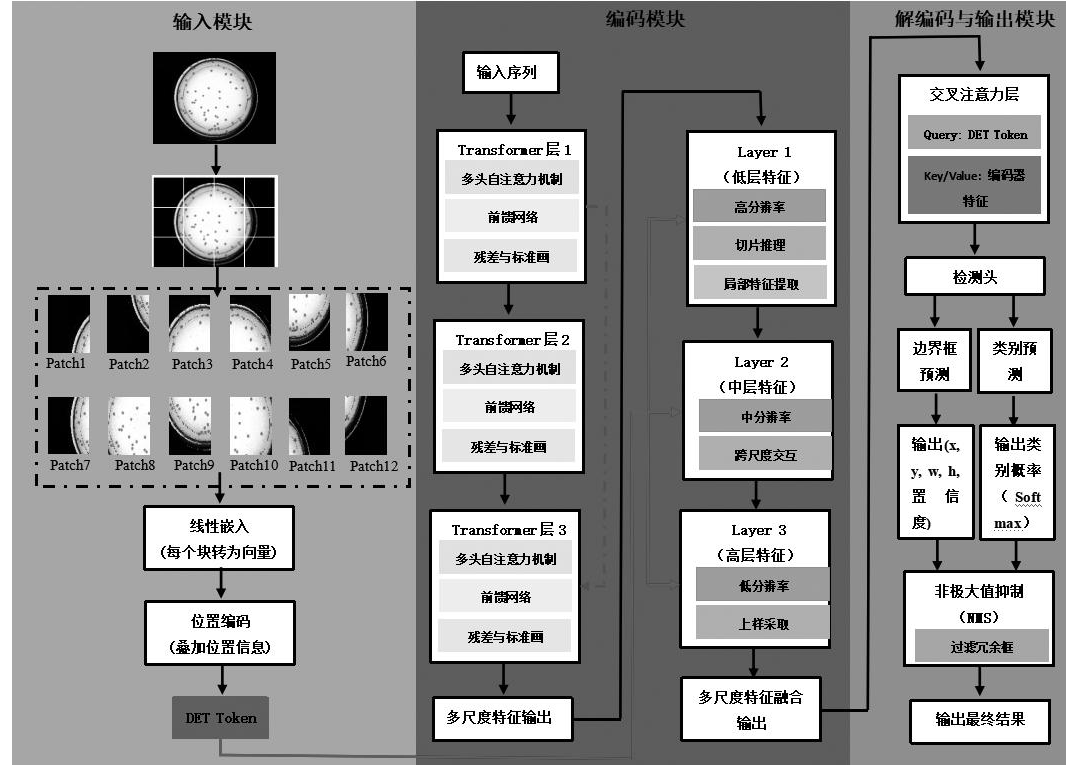

YOLO-Transformer是融合YOLO与Transformer的目标检测模型,遵循ViT(Vision Transformer)结构并引入可学习DET token。其编码器—解码器架构通过跨阶段连接促进信息交互融合,支持多尺度特征融合与切片推理。该模型既突破了传统YOLO依赖卷积神经网络 CNN提取特征的局限,提升小目标检测准确率与精确度,又解决了传统Transformer处理大数据时的计算和内存限制问题,可适应不同大小目标的快速检测需求。YOLO-Transformer 的编码器由多个Transformer层构成,通过跨阶段连接促进信息传递、聚合与融合,增强图像中不同物体特征的交互,提升视觉检测能力;同时支持多尺度特征融合与切片推理,强化对不同大小目标的快速检测能力。

1.3.2 基于YOLO-Transformer的菌落自动识别与计数框架

本研究提出了一种基于YOLO-Transformer的菌落自动识别与计数的框架,如图1所示。该框架的设计旨在充分利用YOLO-Transformer模型在处理不同尺度特征图像、自动学习与归类特征以及能快速处理大规模数据方面的优势,以提高菌落识别与计数的准确性和效率。其中,YOLO模型参考Ultralytics团队开发的开源项目,Transformer相关架构参考Hugging Face团队维护的资源。

本研究提出的菌落自动识别与计数框架由3个阶段组成,各阶段集成多个特征处理模块:第一阶段将原始图像切分为若干小块,并输入至切片训练模型,为后续特征提取奠定基础;在第二阶段中,模型对各切片图像中菌落区域进行细粒度特征提取与融合,形成针对特定菌落类型的唯一高维表征;第三阶段引入预训练与微调机制,基于大规模微生物图像数据进行模型初始化学习,并结合切片推理策略对所提取特征进行归一化与泛化处理,从而增强模型在复杂检测场景中的适应性与鲁棒性,有效提升菌落识别与计数的准确性与稳定性。

1.3.3 实验方法

(1) 样品数据。检测所用的样品数据由深圳海关食品检验检疫技术中心通过检验工作采集。实验采集了样品基质1、样品基质2、样品基质3等动植物来源的具有代表性的样品数据,用于训练与检测。

(2) 准确度测试。本研究依据GB 4789.45—2023《食品安全国家标准 微生物学检验方法验证通则》中实验室内验证要求,验证基于YOLO-Transformer算法的菌落智能计数方法的准确度。基质选择具有代表性的3种动植物来源的样品基质,选择大肠埃希氏菌、柠檬酸杆菌、金黄色葡萄球菌等常见自然污染菌株作为人工污染菌株,分别制成所需浓度菌悬液,用于高水平污染(H)、中水平污染(M)、低水平污染(L)。每个污染水平分别准备2个平行样品,进行5次重复测试,每种基质设置1个空白对照样品,并进行菌落总数检测。本研究中菌落总数检测操作严格遵循GB 4789.2—2022《食品安全国家标准 食品微生物学检验 菌落总数测定》;菌落总数检测结果采用基于YOLO-Transformer算法的菌落智能计数方法(以下简称“仪器法”)和目测法进行菌落计数,其中目测法作为参考方法,由1名具备资质的实验人员进行传统菌落计数。

(3)精密度测试。本研究通过重复性测试和再现性测试的相对标准偏差对仪器法的精密度进行评估,为仪器法的计数结果的稳定性提供量化依据。

① 重复性测试。随机选取3个不同品种的样品,选择适宜的梯度进行检测,每个样品做10组平行试验,实验过程中需加入空白对照,以监控背景干扰和实验误差,完成培养后的样品分别采用仪器法和目测法计数,计算2种方法计数结果的相对标准偏差(Relative Standard Deviation,RSD)。

② 再现性测试。分别采用目测法和仪器法对同一个平皿进行计数;在同一标准环境条件下,仪器法采用基于YOLO-Transformer算法的菌落智能计数方法对同一平皿进行5次菌落计数;目测法选择5名具备微生物检测资质的实验人员分别独立完成菌落计数,统计其计数结果。这2种方法的再现性差异以相对标准偏差来评价。

(4)数据分析。本研究中准确度计算基于实验数据绘制准确度图进行验证,若β-期望容忍区间(β-ETI)的上限U都不高于0.5且下限L都不低于-0.5,则待验证方法准确度符合要求;若有样品β-ETI上限U高于0.5或下限L低于-0.5,但均不超出ALs,则待验证方法准确度也符合要求。本研究中采用相对标准偏差评估精密度,相对标准偏差限值设为10%。

2 结果与分析

2.1 菌落图像数据集介绍

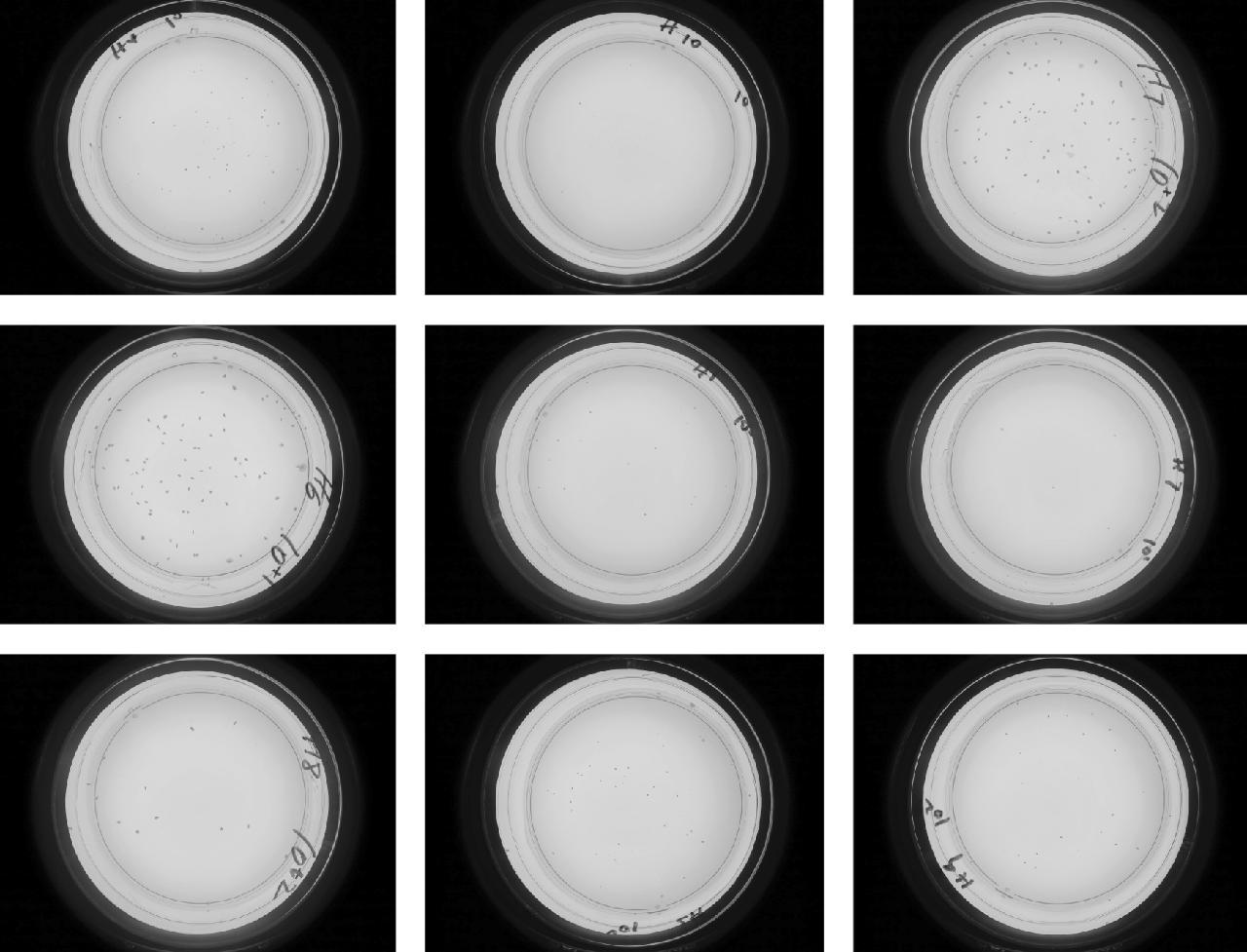

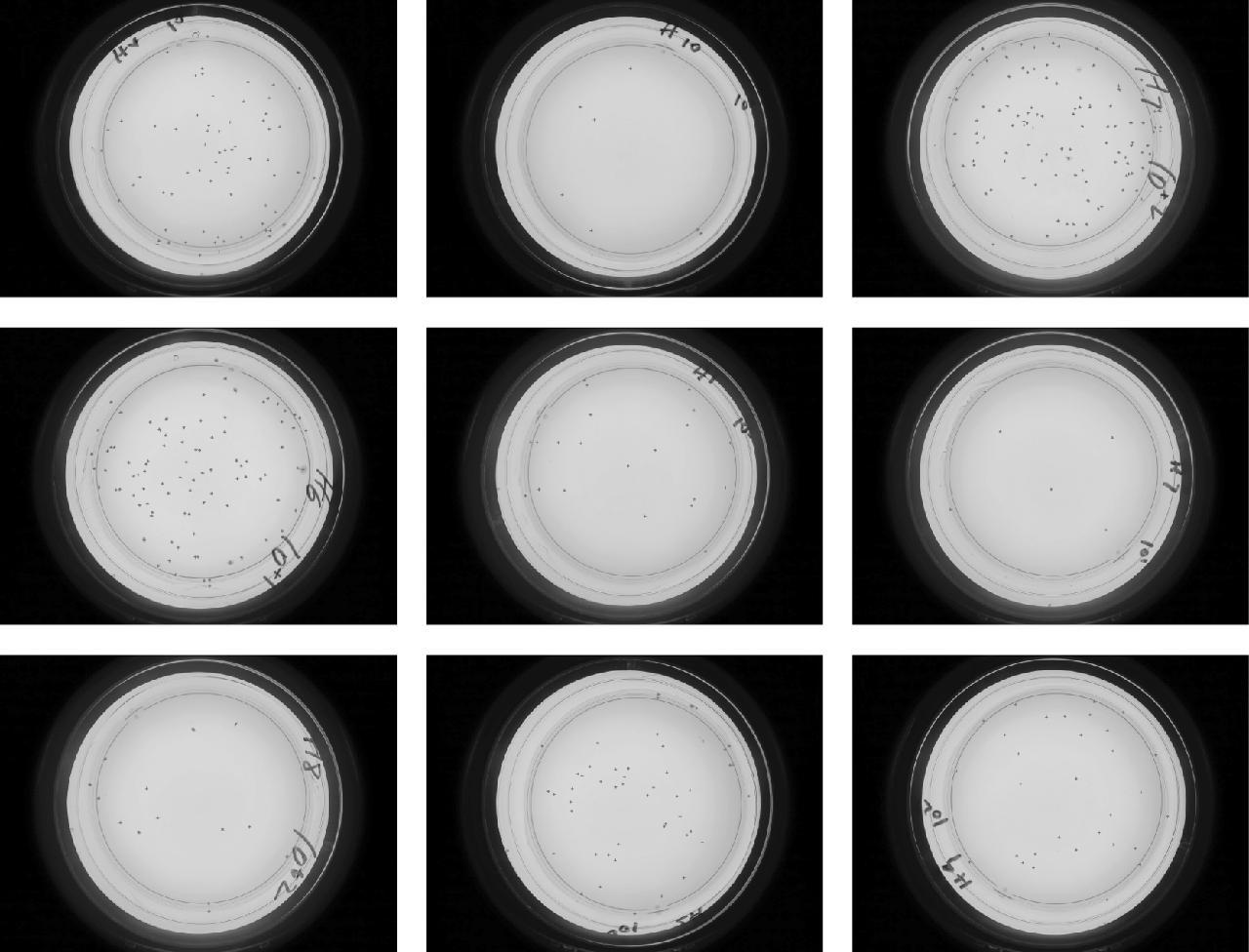

本研究数据集的采集方式为:采用1000万像素照相机,在暗箱、白光环境条件下,对完成48 h培养的样品培养皿进行拍摄。数据集数量共3566张,包含多种样品基质微生物菌落计数的图像,部分图像数据如图所示,对图像里的菌落进行标注(图),提取菌落的特征。

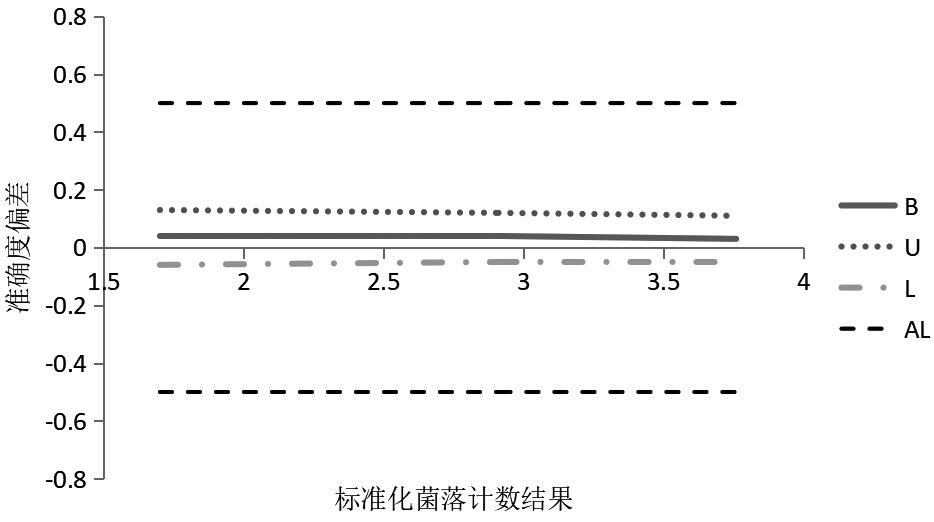

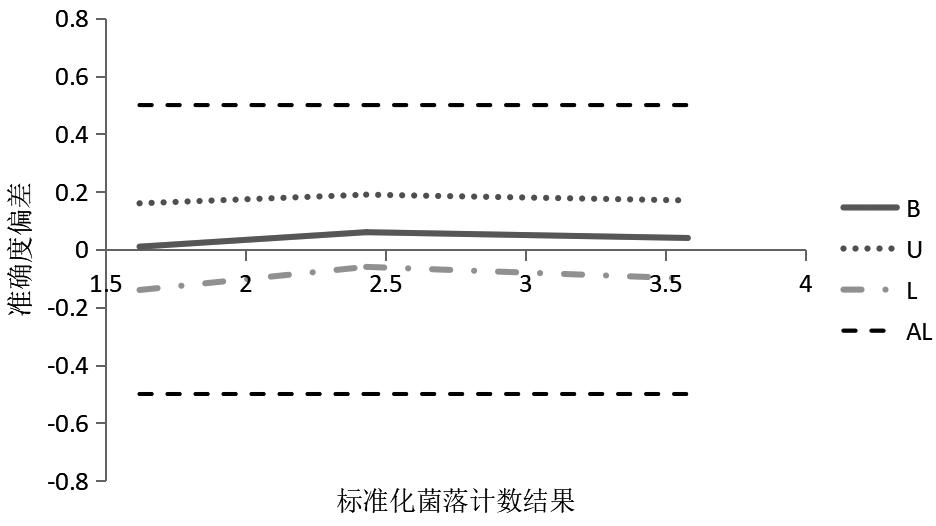

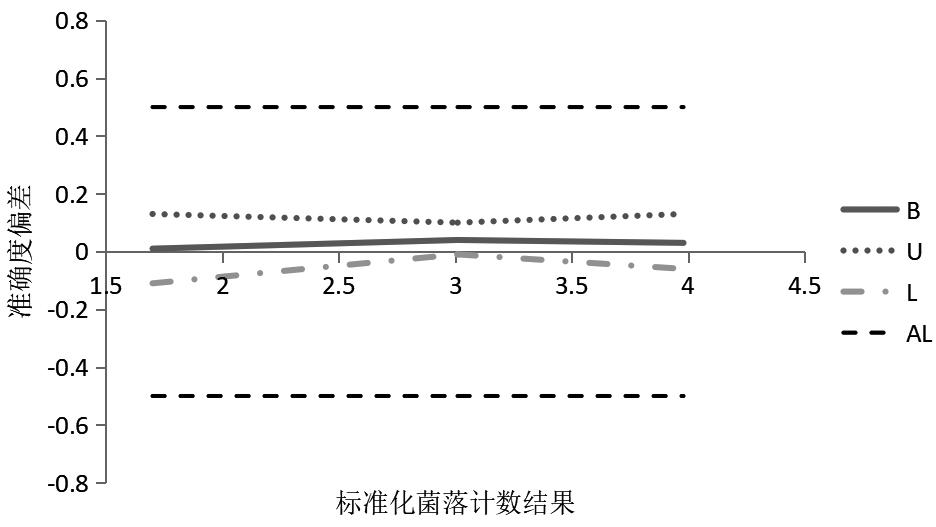

2.2 准确度测试结果

本研究中目标菌株大肠埃希氏菌污染样品基质1、柠檬酸杆菌污染样品基质2、金黄色葡萄球菌污染样品基质3,对经过人工污染后的3种具有代表性的样品基质进行菌落总数检测,培养结果采用仪器法和目测法进行计数,通过准确度测试数据(表、表、3)计算实验室内验证准确度并绘制准确度图(图、5、6),经分析可知β-ETI 上限U都不高于0.5且下限 L都不低于-0.5。根据GB 4789.45—2023中实验室内准确度验证的β-ETI要求可知,基于YOLO-Transformer算法的菌落智能计数方法准确度符合要求。

图4 人工污染后样品基质1的准确度图

Fig.4 Accuracy profile of artificially contaminated sample matrix 1

图5 人工污染后样品基质2的准确度图

Fig.5 Accuracy profile of artificially contaminated sample matrix 2

图6 人工污染后样品基质3的准确度图

Fig.6 Accuracy profile of artificially contaminated sample matrix 3

2.3 精密度测试结果

2.3.1 重复性测试结果

从测试结果()可知目测法的RSD分别为4.64%、4.01%、3.83%,仪器法的RSD分别为4.19%、2.28%、3.13%,RSD均小于10%,且从检测数据可知仪器法计数结果比目测法高。经分析发现,主要原因来自于两个方面:一方面是检测过程中发现平皿上会长出一些特别小的菌落,肉眼难以区分其是样品残渣还是菌落而未计数,YOLO-Transformer智能模型可以检测到肉眼难以观察到的样品残渣与菌落的差异点,从而识别菌落并进行计数;另一方面是生长在培养皿边缘的菌落肉眼难以观察到而漏算,仪器法则可将平皿二维化,让培养皿边缘化为一个二维平面的圆形掩膜,从而识别菌落并进行计数。

2.3.2 再现性测试结果

根据测试结果()可知,不同人员采用目测法和仪器法计数的菌落总数,相对标准偏差分别为3.68%和0.70%,2种方法相对标准偏差均小于10%,符合再现性要求。

3 结论与讨论

本研究通过构建基于YOLO-Transformer算法的菌落智能计数方法,系统评估了其在微生物检测中的性能表现。实验结果显示,该方法在准确度验证中β-期望容忍区间的上限与下限均在±0.5范围内,满足GB 4789.45—2023中实验室内准确度验证的要求。在精密度评估中,重复性测试显示仪器法的相对标准偏差分别为4.19%、2.28%、3.13%,目测法分别为4.64%、4.01%、3.83%;再现性测试中仪器法为0.70%,目测法为3.68%,均低于10%的要求限值。

从具体数据来看,仪器法在重复性测试中的表现优于目测法,尤其是在样品基质2中的相对标准偏差仅为2.28%,低于目测法的4.01%。结果表明,基于YOLO-Transformer的计数方法在稳定性方面具有优势。其原因可能在于该方法通过多尺度特征融合和注意力机制,能够更稳定地识别不同大小和形态的菌落,减少因人工视觉疲劳和主观判断差异带来的计数偏差。

在准确性方面,3种不同污染水平(低、中、高)的样品基质测试结果均显示,仪器法与目测法之间的计数结果一致性较高,β-期望容忍区间均控制在合格范围内。特别是在高水平污染样品中,2两种方法的计数结果差异较小,说明该方法在高菌落密度环境下仍能保持较好的识别准确性。

综上所述,本研究构建的基于YOLO-Transformer的菌落智能计数方法在准确性、重复性和再现性方面均表现出良好性能,在实际应用中可减少人工计数的劳动强度,提高检测效率,为微生物检验工作提供了一种可行的自动化解决方案。

参考文献

[1]李风华, 李雪茹. 生物检测技术在现代食品检验检测中的应用探讨[J]. 中国食品工业, 2022(16): 90-91.

[2]梁春梅, 常建军, 喻东威, 等. 自动菌落计数仪在乳品检测中的应用研究[J]. 食品安全质量检测学报, 2020, 11(1): 146-152.

[3]郭佳, 王娉, 周继福, 等. Microbio方法与平板计数方法在菌落计数中的比较[J]. 食品与发酵工业, 2020, 46(13): 237-243.

[4]武宗茜, 王鹏, 丁天怀. 活动轮廓模型在重叠藻细胞计数中的应用[J]. 计算机工程, 2012, 38(3): 209-211.

[5]王国新, 张长利, 房俊龙. 基于图像处理技术的菌落自动计数系统的研究[J]. 中国乳品工业, 2006, 34(2): 40-42.

[6] Biswas S, Ghoshal D, Hazra R. A new algorithm of image segmentationusing curve fitting based on higher order polynomial smoothing [J]. Optik: Zeitschrift fur Lichtund Elektronenoptik Journal for Lightand Electronoptic, 2016, 127(20): 8916-8925.

[7] Medeiros RS, Scharcanski J, Wong A. Image segmentation via multi-scalestochastic regional texture appearance models [J]. Computer Vision and Image Understanding, 2016, 142, 23-36.

[8]陈林. 基于数字图像处理技术的菌落图像分析与识别方法研究[D]. 鞍山: 辽宁科技大学, 2021: 14-50.

[9]崔绮嫦, 刘泽姿, 罗桂莲, 等. 基于人工智能的全自动菌落计数仪研发[J]. 中国纤检, 2020(12): 66-69.

[10]王彤. 基于机器视觉的微生物样本识别系统开发[D]. 天津: 天津职业技术师范大学, 2021.

[11]张力新, 张黎明, 杜培培, 等. 基于改进水平集的菌落图像智能计数算法[J]. 天津大学学报, 2019, 52(1): 84-89.

[12] Vaswani A, Shazeer N, Parmar N, et al. Attention is all you need [C]//Proceedings of the 31st Conference on Neural Information Processing Systems (NeurIPS), 2017: 5998-6008.

[13] YANG F. A real-time apple targets detection method for picking robot based on improved YOLO[J]. Remote Sensing, 2021,13(9): 1619-1641.

[14] WANG Z, ZHANG X, LI J, et al. A YOLO-hased target detection model for offshore unmanned aerial vehicle data[J]. Sustainability, 2021, 13(23): 1-11.

[15]王婧媛, 方健. 基于YOLO的密集场所人数估计方法[J]. 吉林大学学报(信息科学版), 2021, 39(6): 682-687.

[16] ZHU L, GENG X,LI Z, et al. Imprving YOLO with attention mechanism for detecting boulders from planetary images [J]. Advances in Space Research, 2023, 71(1): 769-780.

[17]高云鹏. 基于深度神经网络的大田小麦麦穗检测方法研究[D]. 北京: 北京林业大学, 2019.

[18]马永康, 刘华, 凌成星, 等. 基于改进YOLO的红树林单木目标检测研究[J]. 国土资源遥感, 2023, 35(2): 109-117.

[19]李志刚, 张娜. 一种轻量型 YOLO交通标志识别方法[J]. 电讯技术, 2022, 62(9): 1201-1206.

[20]杨国亮, 杨浩, 余帅英, 等. 改进YOLO的交通标志检测算法[J]. 计算机工程与应用, 2023, 59(10): 262-269.

[21] Zhen P N, Yan X T, Wang W, et al. Toward compact transformers for end-to-end object detection with decompose chain tensor structure [J]. IEEE Transactionson Circuits and Systems for Video Technology, 2023, 33(2): 872-885.

[22] BADRINARAYANAN V, KENDALL A, CIPOLLA R. SegNet; a deep convolutional encoder-decoder architecture for image segmentation[C]. Transactions on Pattern Analysis and Machine Intelligence. IEEE Computer Society, 2017: 2481-2495.

[23] CHEN L C, PAPANDREOU G, KOKKINOS I, et al. DeepLab:semantic image segmentation with deep convolutional nets, atrous convolution, and fully connected CRFs [J]. Transactions on Pattern Analysis and Machine Intelligence, 2018, 40(4): 834-848.

[24] GIRSHICK R, DONAHUE J, DARRELL T, et al. Richfeature hierarchies for accurate object Detection and Semantic Segmentation[C]. Conference on Computer Vision and Pattern Recognition. Columbus; IEEE Computer Society, 2014: 580-587.

[25] HE K, GKIOXARI G, DOLLAR P, et al. Mask R-CNN [C]. Intemational Conference on Computer Vision (ICCV). Venice: IEEE Computer Society, 2017: 2980-2988.

[26]谭润旭. 基于深度学习的细胞计数研究[D]. 合肥: 安徽大学, 2019.

[27]燕江云, 余雯瑾, 石亚军, 等. 基于YOLOv3算法检测经改良抗酸染色后脑脊液中分枝杆菌图像的研究[J]. 中国医学前沿杂志, 2021, 13(2): 24-29.

[28]侯剑平, 王超, 赵万里, 等. 基于深度学习的白带显微图像细胞识别[J]. 计算机应用与软件, 2021, 38(9): 232-238.

[29] WANG Q, BI S, SUN M , et al. Deep leaming approach to peripheral leukocyte recognition [J]. PLoS ONE, 2019, 14(6): e0218808. DOI: 10.1371/journal.pone.0218808.

[30]王静, 孙紫雲, 郭苹, 等. 改进YOLOv5的白细胞检测算法[J]. 计算机工程与应用, 2022, 58(4): 134-142.

[31] Ultralytics. YOLO: GitHub Repository [EB/OL]. (2020-05-28). https://github.com/ultralytics/ultralytics.

[32] Hugging Face Team. Transformers: GitHub Repository [EB/OL]. (2019-11-24). https://github.com/huggingface/transformers.

[33]程苏云, 任锦玉, 童哲, 等. 实验室菌落计数精密度控制的研究——影响精密度的因素[J]. 中国食品卫生杂志, 2001(5): 11-13.

图1 基于YOLO-Transformer的菌落自动识别与计数框架

Fig.1 Framework for automatic recognition and counting of microbial colonies based on the YOLO-Transformer algorithm

图2 微生物菌落部分图像数据集样例

Fig.2 Representative sample from the microbial colony image dataset

图3 对微生物菌落进行标注的部分图像数据集样例

Fig.3 Sample of the partial image dataset with annotations of microbial colonies

表1 人工污染后样品基质1的准确度测试结果(单位:CFU)

Table 1 Accuracy test data of artificially contaminated sample matrix 1

平行样品 | 仪器法 | 目测法 | 仪器法 | 目测法 | 仪器法 | 目测法 | |||||||||||

L | L | M | M | H | H | ||||||||||||

1 | 46 | 59 | 39 | 50 | 86 | 77 | 80 | 68 | 61 | 53 | 57 | 46 | |||||

2 | 55 | 60 | 52 | 84 | 74 | 95 | 60 | 81 | 68 | 83 | 64 | 66 | |||||

3 | 58 | 63 | 44 | 47 | 88 | 83 | 100 | 76 | 56 | 55 | 54 | 53 | |||||

4 | 50 | 54 | 42 | 44 | 97 | 93 | 88 | 96 | 58 | 54 | 56 | 50 | |||||

5 | 55 | 34 | 48 | 33 | 89 | 74 | 78 | 72 | 70 | 63 | 60 | 58 | |||||

6 | 55 | 58 | 40 | 50 | 76 | 82 | 66 | 75 | 48 | 58 | 42 | 55 | |||||

7 | 50 | 54 | 46 | 44 | 89 | 108 | 74 | 78 | 73 | 56 | 67 | 55 | |||||

8 | 60 | 48 | 52 | 45 | 73 | 83 | 67 | 76 | 77 | 61 | 79 | 57 | |||||

9 | 53 | 70 | 43 | 70 | 118 | 97 | 96 | 91 | 59 | 62 | 56 | 58 | |||||

10 | 57 | 63 | 60 | 59 | 102 | 108 | 96 | 88 | 59 | 68 | 54 | 66 | |||||

表2 人工污染后样品基质2的准确度测试数据(单位:CFU)

Table 2 Accuracy test data of artificially contaminated sample matrix 2

平行样品 | 仪器法 | 目测法 | 仪器法 | 目测法 | 仪器法 | 目测法 | |||||||||||

L | L | M | M | H | H | ||||||||||||

1 | 44 | 39 | 37 | 36 | 30 | 44 | 27 | 35 | 46 | 59 | 39 | 50 | |||||

2 | 44 | 44 | 41 | 39 | 40 | 23 | 32 | 19 | 55 | 60 | 52 | 84 | |||||

3 | 43 | 44 | 39 | 37 | 30 | 24 | 24 | 27 | 47 | 48 | 35 | 41 | |||||

4 | 52 | 56 | 44 | 49 | 28 | 36 | 21 | 24 | 44 | 40 | 36 | 35 | |||||

5 | 52 | 48 | 41 | 41 | 41 | 29 | 33 | 28 | 38 | 41 | 37 | 35 | |||||

6 | 53 | 54 | 37 | 47 | 33 | 39 | 28 | 30 | 38 | 30 | 35 | 24 | |||||

7 | 53 | 39 | 43 | 38 | 31 | 28 | 28 | 21 | 47 | 49 | 37 | 29 | |||||

8 | 41 | 43 | 40 | 40 | 34 | 26 | 28 | 23 | 37 | 33 | 31 | 25 | |||||

9 | 27 | 22 | 42 | 43 | 32 | 39 | 28 | 34 | 35 | 28 | 27 | 35 | |||||

10 | 40 | 39 | 47 | 45 | 22 | 28 | 24 | 26 | 32 | 41 | 39 | 34 | |||||

表3 人工污染后样品基质3的准确度测试数据(单位:CFU)

Table 3 Accuracy test data of artificially contaminated sample matrix 3

平行样品 | 仪器法 | 目测法 | 仪器法 | 目测法 | 仪器法 | 目测法 | |||||||||||

L | L | M | M | H | H | ||||||||||||

1 | 72 | 45 | 44 | 50 | 94 | 105 | 107 | 85 | 116 | 105 | 109 | 97 | |||||

2 | 72 | 49 | 56 | 50 | 104 | 105 | 104 | 103 | 106 | 128 | 94 | 118 | |||||

3 | 55 | 60 | 52 | 84 | 121 | 121 | 112 | 107 | 119 | 87 | 103 | 82 | |||||

4 | 54 | 51 | 44 | 65 | 131 | 114 | 102 | 105 | 120 | 108 | 105 | 101 | |||||

5 | 60 | 53 | 45 | 63 | 124 | 119 | 108 | 107 | 123 | 103 | 122 | 88 | |||||

6 | 33 | 54 | 48 | 54 | 98 | 107 | 96 | 82 | 117 | 97 | 112 | 90 | |||||

7 | 61 | 46 | 42 | 51 | 120 | 110 | 103 | 101 | 97 | 95 | 95 | 90 | |||||

8 | 18 | 38 | 31 | 42 | 111 | 114 | 109 | 98 | 113 | 117 | 106 | 95 | |||||

9 | 41 | 42 | 46 | 49 | 125 | 127 | 115 | 101 | 86 | 92 | 84 | 84 | |||||

10 | 68 | 47 | 43 | 38 | 117 | 103 | 103 | 100 | 76 | 82 | 66 | 75 | |||||

表4 重复性测试结果

Table 4 Results of repeatability tests

序号 | 检测次数 | 菌落数 (CFU/皿) | |||||||

样品基质1 | 样品基质2 | 样品基质3 | |||||||

目测法 | 仪器法 | 目测法 | 仪器法 | 目测法 | 仪器法 | ||||

1 | 第1次 | 38 | 38 | 104 | 105 | 52 | 52 | ||

2 | 第2次 | 35 | 38 | 103 | 103 | 51 | 52 | ||

3 | 第3次 | 39 | 37 | 109 | 105 | 55 | 53 | ||

4 | 第4次 | 37 | 39 | 98 | 103 | 54 | 53 | ||

5 | 第5次 | 38 | 39 | 109 | 108 | 54 | 54 | ||

6 | 第6次 | 35 | 35 | 98 | 109 | 51 | 54 | ||

7 | 第7次 | 35 | 37 | 107 | 104 | 51 | 54 | ||

8 | 第8次 | 36 | 39 | 109 | 106 | 50 | 49 | ||

9 | 第9次 | 39 | 41 | 106 | 108 | 50 | 54 | ||

10 | 第10次 | 35 | 38 | 103 | 102 | 55 | 51 | ||

相对标准偏差 (%) | 4.64% | 4.19% | 4.01% | 2.28% | 3.83% | 3.13% | |||

表5 再现性测试结果

Table 5 Results of reproducibility tests

实验人员编号 | 菌落数 (CFU/皿) | |

目测法 | 仪器法 | |

人员1 | 110 | 118 |

人员2 | 118 | 119 |

人员3 | 116 | 118 |

人员4 | 112 | 120 |

人员5 | 108 | 119 |

相对标准偏差 (%) | 3.68% | 0.70% |